26년 5월 1주차 그래프 오마카세

Topology-Aware Representation Alignment for Semi-Supervised Vision-Language Learning

Keywords

- Semi-supervised Learning

- Topological Data Analysis

- Persistent Homology

- Representation Alignment

- 사람들은 이미지와 텍스트를 자연스럽게 같은 의미로 이해합니다.

하지만 AI 모델에게 이미지는 픽셀의 배열, 텍스트는 토큰의 시퀀스라는 전혀 다른 방식으로 구성된 데이터입니다. - CLIP 같은 VLM은 범용적인 상황에서 인상적인 성능을 보이지만 위성, 도시 이미지, 의료 영상처럼 특화된 도메인에서는 크게 흔들립니다. 이는 도메인 특화 데이터를 충분히 모으기 어렵다는 현실적인 제약 때문입니다. 이러한 한계를 완화하기 위해, 일반적으로는 Semi-supervised Learning이 활용됩니다.

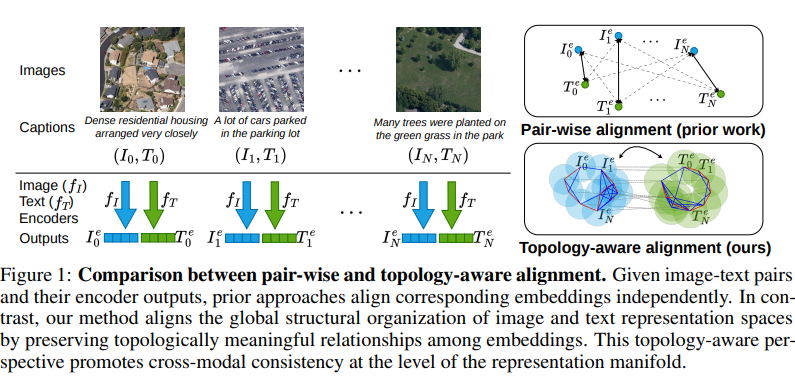

- 그런데 기존 방법들에는, 이미지와 텍스트를 쌍으로만 맞추고, 전체적인 표현 공간의 구조는 신경 쓰지 않습니다. 이미지 임베딩 공간과 텍스트 임베딩 공간은 각자 다른 기하학적 편향을 가지고 있기 때문에, 개별 쌍을 아무리 잘 맞춰도, 두 공간의 전역적 구조가 어긋나 있다면 진정한 의미의 정렬이라고 보기 어렵습니다.

- 이번 논문 ToMA(Topology-Aware Multimodal Representation Alignment) 는 바로 이 질문에 대한 해답을 찾기 위해, 위상수학의 지속적 호몰로지(Persistent Homology, PH)라는 도구를 활용해 임베딩 공간에서 의미 있는 연결 구조를 추출하고, 이를 두 모달리티 간에 정렬하는 방법을 제안합니다.

- 해당 논문을 이해하기 위한 정도로만 빠르게 위상수학 핵심 개념들을 짚고 넘어가겠습니다.

- 위상수학이 데이터에서 보는 것

- 위상수학(Topology)은 한마디로 형태의 본질적인 구조 를 연구하는 수학입니다. 여기서 중요한 점은 두 점 사이의 정확한 거리보다 이 점들이 어떻게 연결되어 있는가입니다. (연결성에 집중)

- 자르거나 뜯어내지 않고 어떻게 늘리거나 구부려도 서로 변형될 수 있는 한, 호모토피(Homotopy) 정의로부터 세세한 수치보다 구조의 본질을 보는 것이 핵심입니다.

- 대표적인 예시로, 커피잔과 도넛이 많이 언급됩니다. 이들은 기하적으로는 전혀 다른 형태를 갖지만, 위상적으로는 둘 다 구멍이 하나인 같은 형태로 볼 수 있습니다.

- 이 관점을 데이터에 적용한 것이 위상 데이터 분석(TDA, Topological Data Analysis) 입니다. 고차원 임베딩 공간에 흩뿌려진 데이터 포인트들이 전체적으로 어떤 구조를 이루는지, 즉 어떻게 뭉치고, 어떤 루프를 형성하는지를 포착합니다.

- 지속적 호몰로지(Persistent Homology)

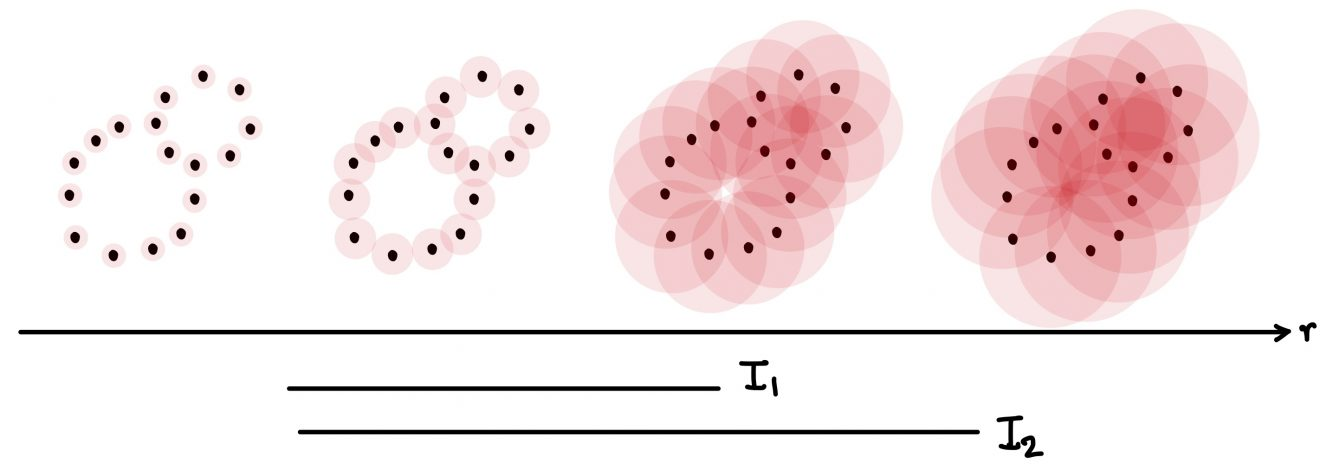

- 공간에 흩뿌려진 포인트 클라우드를 중심으로 작은 원을 조금씩 키워가면서 겹치는 원의 포인트들끼리 연결하며 어떻게 데이터가 구조화되는지를 추적하는 방법입니다.

- 이 과정에서, (a) 서로 분리되어 있던 두 원이 처음 겹치는 순간, 두 덩어리가 하나로 연결되는 경우(연결 요소, H₀)와 (b) 여러 원들이 이어지면서 내부에 빈 공간을 가진 고리(루프, H1)가 생기는 순간을 포착합니다.

- 이 연결 요소 및 루프가 언제 고유하게 생겨나고 언제 주변 구조와 병합되어 사라지는지를 기록하는 것이 지속적 호몰로지입니다. 오래 살아남는 위상적 특징일수록 노이즈가 아닌 데이터의 본질적인 구조를 반영한다고 해석합니다. 이러한 해석은 단순히 가깝다의 거리 정보를 넘어, 이들이 모여 하나의 의미 덩어리를 이루고 그것이 어떤 구조로 연결되어 있는지의 구조적 맥락으로 이해할 수 있습니다.

- 기존 방법들은 매칭된 이미지-텍스트 쌍의 임베딩을 가깝게 당기는 데 집중합니다. 그러나 두 모달리티 간에는 Modality Gap이 존재하고, 이로 인해 각 공간은 서로 다른 기하학적 편향을 가집니다.

- Platonic Representation Hypothesis의 연구에서 저자들은 서로 다른 모달리티의 표현이 결국 동일한 추상적 구조로 수렴할 수 있다고 제안합니다. ToMA는 이 가설에서 영감을 받아 표현 매니폴드(Representation manifold)의 전역적 위상 구조를 정렬하는 것을 목표로 합니다.

- 이전에도 위상수학을 표현 학습에 활용하려는 시도가 있었습니다. 대표적으로 최적 운송 거리 (e.g. Wasserstein & Bottleneck distance) 기반의 지속 다이어그램(Persistence Diagram, PD : H₀, H1 구조가 생기고 사라지는 시점을 2D 좌표로 맵핑하여 평면에 요약하는 시각화 기법) 매칭 방식인데, 여기에는 두 가지 한계가 있습니다.

- PD는 Non-injective하므로, 표현 공간의 기하학을 완전히 요약하지 못합니다. 즉, 서로 다른 두 공간이 동일한 PD를 가질 수 있어, PD 거리를 최소화해도 실제 공간이 정렬된다는 보장이 없습니다.

- PD 매칭은 이미지-텍스트 쌍 정보를 직접 활용하지 않습니다. 그로부터 VLM의 핵심 정보인 모달리티 쌍을 무시해버리는 셈입니다.

- ToMA는 PD를 매칭 목표로 삼는 대신, PH를 통해 선별된 위상적으로 중요한 엣지의 방향을 직접 정렬합니다. 이를 위해 두 종류의 엣지를 활용합니다.

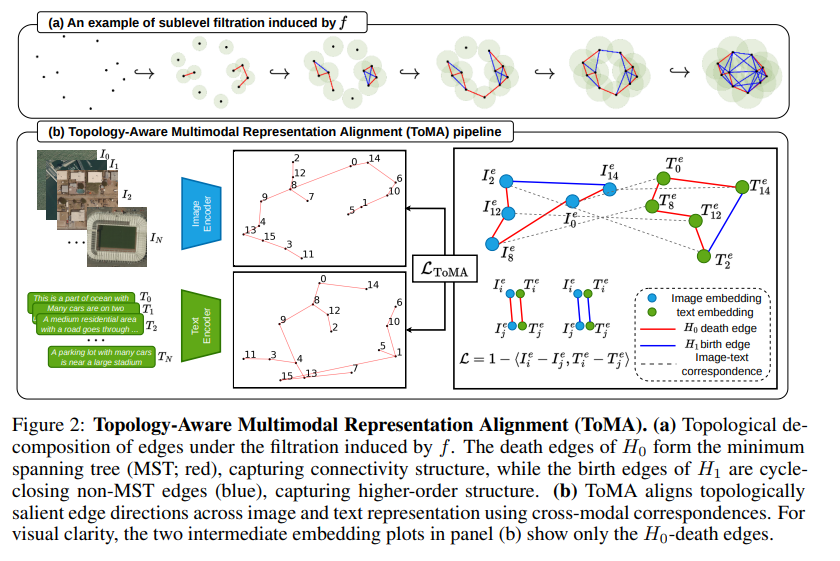

- H₀-death 엣지 : H₀ 클래스가 소멸할 때, 즉 두 원이 처음으로 겹치는 순간 사용되는 엣지들은 전체 데이터를 연결하는 뼈대, 즉 Minimum Spanning Tree(MST)를 구성한다는 점을 활용합니다.

- H₁-birth 엣지 : H₁ 클래스가 탄생할 때의 엣지는 MST 위에 형성된 경로를 닫아 사이클을 만드는 엣지입니다. MST가 이미 만들어 놓은 경로들 위에 하나의 엣지가 추가되어 루프가 완성되는 순간입니다. ToMA는 삼각형 이상의 고차원 구조를 구성하지 않는 방식을 써서 계산 비용을 최소화합니다.

- ToMA는 유클리드 거리가 아닌 엣지의 방향을 정렬하는 부분에서 기존 CLIP과 차별성을 갖습니다. 이미지 공간에서 선택된 엣지에 대해, 대응하는 텍스트 공간의 엣지 방향이 얼마나 일치하는지를 코사인 유사도로 측정합니다.

- 또한 방향의 절댓값을 취함으로써, 정렬 목표가 평행(parallel)이든 반평행(anti-parallel)이든 상관없이 동일한 1차원 관계 부분공간을 정렬하게 합니다. 이 설계가 없으면 성능이 크게 저하된다는 것이 실험으로 확인됩니다.

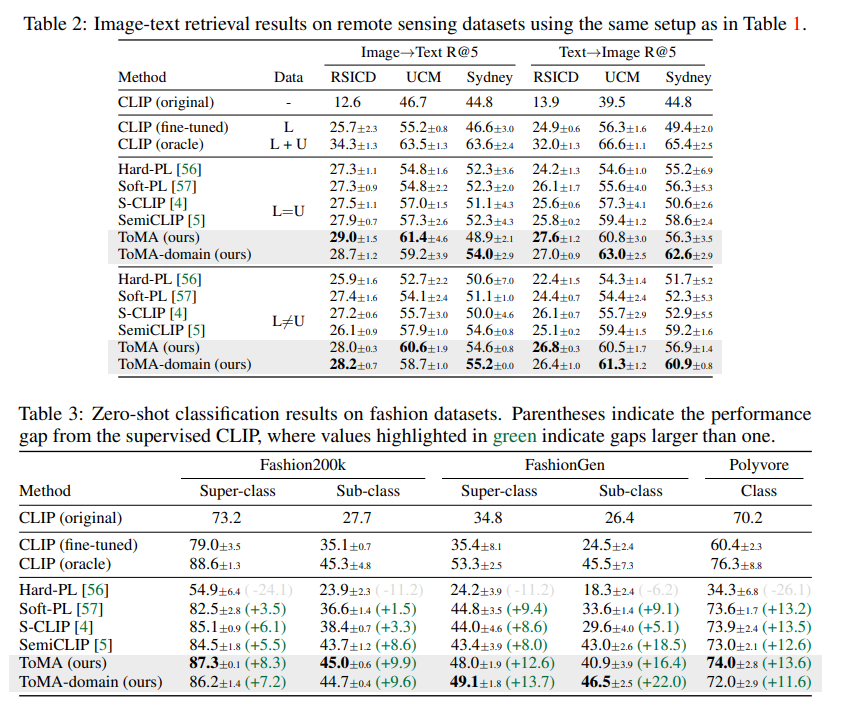

- Remote Sensing 데이터셋에서 ToMA는 기존 최강 베이스라인인 SemiCLIP 대비 제로샷 분류, 이미지-텍스트 검색에서도 전반적으로 일관된 향상을 보여줍니다. Fashion 데이터셋에서도 FashionGen 슈퍼클래스 분류에서 SemiCLIP 대비 최대 +5.7%, 서브클래스 분류에서 CLIP 대비 최대 +22% 향상되는 등 안정적인 성능 개선이 나타납니다.

- 해당 실험결과에서 주목할만한 부분들은 아래와 같습니다.

- H₁-birth 엣지만 사용해도 H₀ 없이 SemiCLIP을 뛰어넘는 경우가 있습니다. 배경 설명에서의 루프 구조 신호가 독립적으로도 유용하다는 의미입니다.

- H₀와 H₁을 함께 쓸 때 두 성분이 상보적으로 작용해 가장 안정적인 성능이 나옵니다. 연결성과 루프 구조, 두 가지 위상 정보가 각자 다른 측면을 보완합니다. 계산 비용 증가 측면에서도 실용적입니다.

- CLIP은 이미지와 텍스트를 쌍으로 맞추는 데 특화되어 있지만, 두 임베딩 공간의 전역적 구조가 일치한다는 보장은 없습니다.

- 이 간극을 메우기 위해, 논문 저자들은 지속적 호몰로지로 각 공간의 구조적 뼈대를 이루는 엣지들을 선별하고, 그 엣지들이 이미지와 텍스트 공간에서 같은 방향을 가리키도록 정렬합니다. 여기에서 PD 매칭이라는 간접적인 방식 대신, 위상적으로 의미 있는 엣지를 직접 정렬 대상으로 삼은 것이 핵심입니다.

- 이미지와 텍스트 임베딩 공간의 전역적 위상 구조를 그래프 구조로 정렬하고, 그 위에서 MST를 통해 H₀-death 엣지를 선별하며 H₁-birth 엣지를 통해 사이클 정보를 활용하는 아이디어는 이 논문이 제시하는 주요 인사이트 중 하나입니다.

[Contact Info]

Gmail: jhbae1184@akane.waseda.jp

Twitter (X): @jhbae1184